哎呀,讲到跳舞,一个人跳得再劲,有时候总觉得少了点啥子味道,对不啦?就像喝早茶,一笼虾饺再好,没配上那壶普洱,终究不够圆满。双人舞那种你来我往、眼神手势都要对上的默契和互动,才是舞蹈里头最勾魂摄魄的精华。但你可晓得,要让AI学会编这种“互打舞蹈”,里头有多少让人头大的门道?今天我们就来摆摆这个龙门阵,看看AI是怎么磕磕绊绊,又一步步摸到双人互动编舞的门槛的。

第一道坎:从“独善其身”到“成双成对”

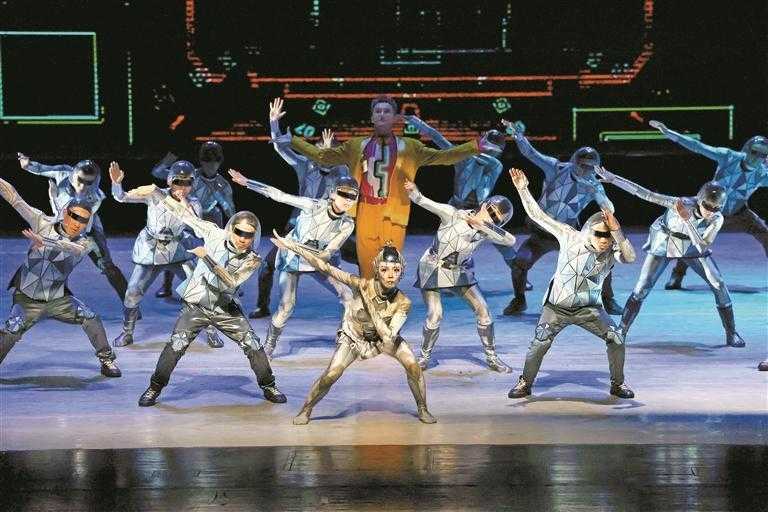

早前的AI编舞啊,多半是个“独行侠”。它们训练用的数据,清一色是单人舞的动作捕捉,模型学得再好,生成的动作也是一个个孤零零的,你跳你的,我跳我的,中间像隔了层看不见的玻璃墙-1。这哪叫双人舞嘛,分明是两台舞蹈机器碰巧站到了一起。真正的双人舞,讲究的是气息相连、动作呼应,手眼身法步都要有交流,甚至要能传递情绪。打个不恰当的比方,之前的AI就像只会背单词,但根本不懂怎么把单词串成一句有来有往的对话。

所以嘞,科研仔们就开始琢磨了,得整点新活儿。这不,有个叫“Dyads”的研究就冒出来了,专门死磕“艺术家中心”的AI生成双人舞-1。他们搞了个基于概率和注意力机制的变分自编码器模型。说人话就是,这个模型不单单学动作本身,更要去学两个舞者之间那种复杂的互动概率。你出一招,我根据你的招式、咱们的相对位置,还有音乐的节奏,来生成最匹配、最和谐的那一式来回应。这初步让互打舞蹈AI有了点“对话”的苗头,不再是各跳各的哑剧了-1。

第二道坎:“同步”不是“复制”,动作得讲物理

光是能对话还不行,对话还得自然,不能各说各话。双人舞最怕啥?怕不同步,怕动作假。一个要托举,另一个的力还没送到位;一个转身,另一个的配合慢了半拍,那画面简直不敢看,假得让人出戏。

Meta的GenAI团队为此搞了个叫VideoJAM的视频生成框架,专门对付这种运动一致性的难题-9。他们有个妙招,在训练时给模型额外灌输了“运动信息”。就像不光给你看一幅幅静态画面,还把每幅画面之间的变化箭头也画给你看。他们用一种叫“光流”的技术,把像素的运动方向和强度变成模型能看懂的颜色和亮度信息-9。更绝的是,他们在模型生成视频的过程中,加了个“内部引导”机制。让模型自己边生成,边检查自己预测的动作连贯不连贯,一旦发现要跑偏,立马自个儿调整回来-9。这套组合拳打下来,生成的双人舞视频,动作同步率和物理真实感噌噌往上涨,哪怕是倒立、抛接这种高难度活儿,两个人也配合得像模像样-9。这让互打舞蹈AI生成的内容,从“能看”进阶到了“有点真”的阶段。

第三道坎:人一多就“打架”,脚下像抹油

解决了双人同步,问题就完了?想得美!现实中的群舞(双人舞也可以看作最小的“群”),人一贴近,新麻烦又来了。最搞笑又最常见的问题有两个:一是舞者跳着跳着就撞到一起了,二是脚底下像穿了溜冰鞋,各种滑步,毫无扎根地面的扎实感-5。

为啥会这样?研究者一分析,发现数据里头八成以上的动作看起来都差不多,但每个舞者全身关节数据维度巨高,模型直接“脸盲”了,根本分不清谁是谁,可不就乱套撞车了嘛-5。至于滑步,那是因为AI很难协调全身腾挪和脚下轨迹的关系,经常顾了上身动作,忘了脚该踩在哪儿-5。

南理工、清华、南大联手弄出的TCDiff++模型,就是来当这个“舞蹈纠察队长”和“防滑鞋匠”的-5。它有个“团体舞蹈解码器”,先根据音乐生成一套大体协调、避免碰撞的初始队形和动作。接着,专门的“步法适配器”上场,聚焦优化脚后跟、脚趾的触地状态,生成实实在在的踩地步法,再把扎实的下盘和优美的上身动作融合起来-5。这套流程下来,总算让AI编的舞看起来像一群人在有组织地跳舞,而不是无头苍蝇乱撞或者在地板上飘了-5。

从舞台到指尖:虚拟人与游戏的狂欢

技术一突破,应用场景就开了花。最直接的,就是给虚拟数字人注入灵魂。以前的虚拟偶像,美则美矣,表情动作却总是那副标准的“营业脸”,说话像棒读,跳舞像机械-4。现在有了DreamTalk这类框架,虚拟头像不仅能对你开口说话,还能根据语音内容配上生气、开心、鄙视等各式各样的情绪表情,嘴型也对得上-4。试想一下,当这样的虚拟偶像再搭载上我们前面说的互打舞蹈AI引擎,她不仅能和你智能对话,还能根据实时音乐,拉上另一个虚拟伙伴或者直接和你(通过动作捕捉)来上一段即兴的双人舞互动,这体验是不是就鲜活多了?这不再是预录制的僵硬动画,而是真正有来有往的个性化表演-4。

另一个火爆的方向是游戏。韩国就推出了一款融合空间计算和生成式AI的K-pop舞蹈挑战游戏概念-6。玩家可以和朋友或者AI生成的虚拟对手进行舞蹈对战。这里的AI对手,其舞蹈动作很可能就是由前述那些先进的舞蹈生成模型实时驱动的,它能根据音乐和你的表现,生成既符合节奏又具有挑战性的互动舞步,让你体验到近乎无穷的游戏可玩性和沉浸感-6。

文化的反攻:方言与算法的一场“乌龙”

说到这儿,插播一个特别有意思的事儿。技术在狂奔,但文化也在用自己的方式“调皮”地抵抗。有个叫《食吔》的潮语朋克乐队,干了一件特别“夯”的事。他们用浓烈的潮汕方言演唱,夹杂大量地方俚语,比如“你勿四散呾”(你别乱说)、“猛猛走”(快跑)-2。你猜怎么着?那些训练数据里潮语占比极少的AI语音识别系统,在他们面前直接懵圈了,把歌词错误百出地解码成完全不相干的字句,甚至闹出大笑话-2。这就像一场精心策划的“声波游击战”,用算法无法解析的文化密语,给AI殖民者来了次小小的滑铁卢-2。

这事儿反过来也给我们启发。当AI试图学习并生成一切时,那些最地道、最鲜活、最“土”的文化元素,比如方言里的韵律、方言歌曲里的特殊转音,反而成了最坚固的“反AI识别”壁垒。它提醒我们,在追求技术通用性的同时,必须为文化的多样性留下不可被标准化吞噬的空间。未来,或许最顶尖的互打舞蹈AI,不仅要能编出标准的华尔兹或街舞,还得能理解和生成融入了特定民族、地域文化互动韵律的舞蹈,那才算是真正读懂了人类身体语言的百科全书。

所以说啊,让AI学会编双人舞,乃至群舞,这条路走得是真不容易。从学习互动,到打磨同步与真实感,再到解决多人碰撞和滑步的细节,每一步都是坑。但眼看着它从僵硬到流畅,从独舞到有互动,再应用到虚拟人和游戏里,这场面还是挺让人期待的。至于未来嘛,就像那场方言朋克带来的启示,最好的状态大概是:AI成了我们延伸想象力和创造力的强大工具,但舞蹈中最炽热的情感、最独特的文化印记,永远来源于我们真实的身体与灵魂的碰撞。这场人与AI的共舞,精彩才刚刚开始。