哎,你说现在这AI,本事是越来越大,可它肚子里到底琢磨些啥,咱们是越来越看不明白了。这就好比找了个顶级顾问,他给你出的主意个个精妙,可你要问他为啥这么想,他只能挠挠头说“凭感觉”——这谁心里能踏实啊?这就是AI开黑箱问题最让人头疼的地方-6。它已经不是实验室里的学术话题,而是切切实实卡住了AI往金融、医疗这些要紧地方迈的腿-10。

黑箱里头,到底是啥光景?

咱们先掰扯清楚,这“黑箱”到底黑在哪儿。它可不是一个毛病,而是三层“看不懂”摞一块儿了-6。

第一层,是结构太复杂,跟一团乱麻似的。现在的AI大脑(比如Transformer),动辄几百亿个参数,它们之间的联系比热带雨林的藤蔓还密-1。一个决定,是千千万万个“神经元”一起嘀咕出来的结果,你想追踪到底是哪条思路起了关键作用?难!

第二层,是脾气摸不准,时不时给你来个惊喜(吓)。就算在正常情况下一帆风顺,保不齐遇到个没见过的新情况,或者被人故意使点小绊子(比如在图片上加点儿人眼看不出的噪声),AI可能就会做出完全离谱的判断-6。这种不稳定性,在开车、看病这种事儿上,可是要了命了。

第三层,也是最根儿上的问题,是AI只懂关联,不懂因果。它可能通过海量数据学到“下雨”和“带伞”总是一起出现,所以一看要下雨就提醒你带伞。但它并不真正理解“因为下雨会淋湿,所以需要伞来挡雨”这个逻辑链条-6。这种“知其然不知其所以然”,让它的决策缺乏坚实的逻辑根基,像个凭经验办事的“老油条”,而不是个讲道理的“明白人”。

技术猛人,正拿着“手术刀”往里探

那这黑箱就真打不开了吗?也不尽然。全球顶级的实验室都在琢磨这事儿,而且还真有了些眉目。

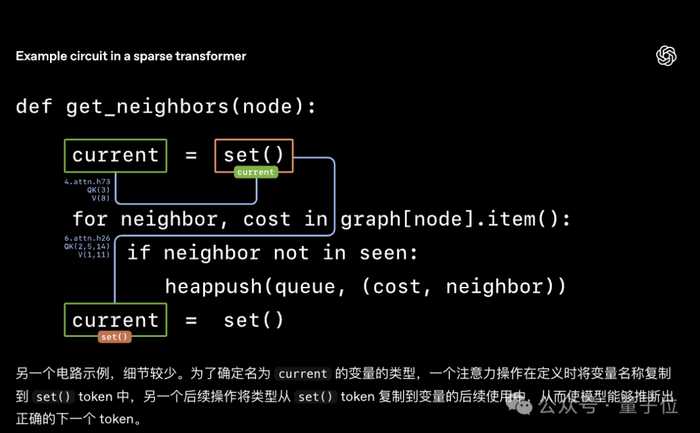

OpenAI这帮人想了个挺绝的法子:既然脑子太乱看不清,那咱能不能在“长脑子”的时候,就让它长得规整点儿?他们搞了个“稀疏Transformer”,简单说,就是强行规定大脑里的神经元不能随便瞎连接,只能跟有限的几个邻居通信-1。这就好比把一片盘根错节的野生丛林,修剪成一片行列整齐的人工林,哪棵树干了啥,一目了然。

你猜怎么着?在这类规整的大脑里,研究人员真的找到了非常清晰、小巧的“功能电路”。比如,负责识别代码里引号是成对出现的,就那么几个专门的神经元,分工明确,逻辑清晰得就像教科书上的示例算法-1。这可太有意思了,说明AI开黑箱这事儿,从模型设计的源头上,就有希望取得突破。将来要是能给AI的关键决策都配上这样的“电路图”,咱们的信任度肯定蹭蹭往上涨。

更有意思的尝试是,让AI去解释AI。OpenAI另一项研究,干脆让更聪明的GPT-4,去当“心理医生”,分析GPT-2的几十万个神经元都在想啥-4。这就好比让一个更成熟的人,去揣摩另一个人的心思。虽然GPT-4自己也是个“黑箱”,这有点“黑箱解黑箱”的味道,但初步结果发现,它在不少时候的理解,还真能接近人类水平-4。这或许是一条“以毒攻毒”的蹊径。

道高一尺,魔高一丈的“隐身术”

就在科学家们想方设法让AI更透明的同时,另一条赛道上却在上演完全相反的戏码:如何让AI的产出更像人,从而骗过检测系统。

现在网上已经有不少攻略,教人怎么用“提示词工程”给AI生成的内容“化妆”。比如,明确要求AI模仿人类口语化的表达,加入情绪起伏,避免机械的重复-8。甚至有些高级玩法,会指令AI使用复杂的句法结构、替换专业术语,故意制造一些看似合理的“伪错误”或不连贯,以此来抹掉机器生成的整齐划一的痕迹-8。

有测试表明,经过一番精心“润色”,AI生成文本被检测工具识破的概率,能从100%显著下降-8。你看,这多像一场永无休止的“猫鼠游戏”。这从反面印证了,如果我们不能真正理解AI生成内容的本质来源和逻辑,仅靠表面的特征检测,防线是相当脆弱的。这让AI开黑箱的努力显得更加紧迫——因为我们需要的是看透本质的“火眼金睛”,而不是只能识别表面特征的“肤浅滤镜”。

所以,咱图个啥?

说到底,咱们费这么大劲,非要打开这个黑箱子,图个啥?

图个安心,图个责任,图个真正的进步。当AI建议医生用某种激进疗法时,医生需要知道这个建议是基于可靠的医学关联,还是数据中的一个巧合-10。当AI拒绝了一个人的贷款申请,这个人有权知道是因为信用记录,还是因为模型里藏着一个连开发者都没察觉的偏见-10。

这不仅仅是为了满足我们的好奇心。在AI愈发深入人类社会肌理的今天,透明度是信任的基石,而信任,是所有技术得以长久服务于人的前提。打开黑箱,是为了能放心地把更重要的方向盘交给AI,也是为了在它跑偏时,我们能准确地找到扳手,而不是对着一个铁疙瘩干瞪眼。

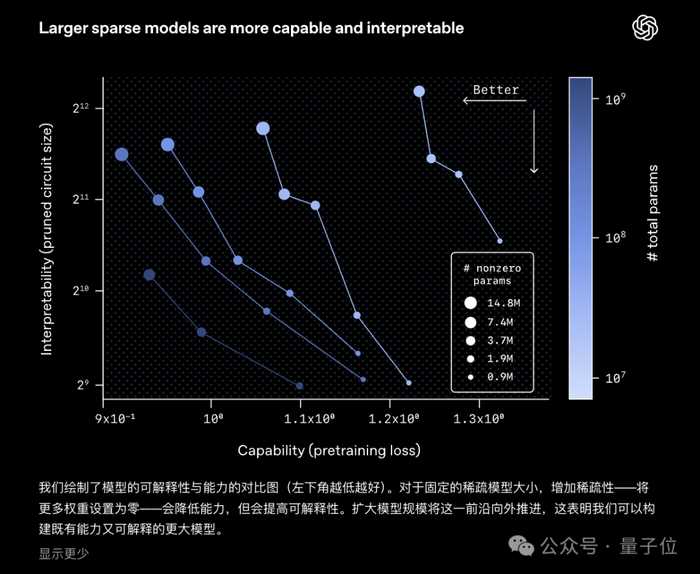

这条路还长,稀疏模型会损失一些性能,自动化解释还不完美-1。但至少,光已经照进去了。咱们一边期待着科学家们造出更透亮的“玻璃箱”,一边在用它的时候,也多留个心眼儿。毕竟,和一个心思完全猜不透的伙伴共事,那感觉,总归是有点儿不踏实,你说是不是?