ICCV 2025满分论文:一个模型实现空间理解与主动探索大统一

想象一下,AI能否像人类一样“看懂”世界并主动探索?这项研究给出了肯定答案!本论文核心团队来自北京通用人工智能研究院机器学习实验室,负责人李庆博士长期深耕多模态理解、智能体与具身智能,主页:https://liqing.io

人工智能正从虚拟网络空间迈向真实物理世界,但关键挑战在于:如何让智能体理解三维空间,并实现语言与环境的精准对齐?现有3D模型虽在感知上进步,却依赖静态观察,缺乏主动探索能力。

为此,清华大学、北京通研院、北理工与北航团队联合推出统一模型,融合空间理解与主动探索。它让智能体在动态探索中构建环境认知,实现高效感知与导航,为物理世界任务奠定基础。该成果已被ICCV 2025收录,获审稿人一致满分评价。

论文Move to Understand a 3D Scene: Bridging Visual Grounding and Exploration for Efficient and Versatile Embodied Navigation论文链接:https://arxiv.org/abs/2507.04047项目主页:https://mtu3d.github.io代码链接:https://github.com/MTU3D/MTU3D

论文Move to Understand a 3D Scene: Bridging Visual Grounding and Exploration for Efficient and Versatile Embodied Navigation论文链接:https://arxiv.org/abs/2507.04047项目主页:https://mtu3d.github.io代码链接:https://github.com/MTU3D/MTU3D

理解与探索:具身导航的“双引擎”驱动

在具身导航中,智能体需根据人类指令在复杂空间定位目标。这不仅需“听懂任务”,更需“主动探索”,这正是核心挑战。导航包含两个交织步骤:

理解(Grounding):智能体将指令匹配到空间,如“餐桌”对应具体位置。探索(Exploring):在未知环境中移动观察,以发现目标区域。

如同人类寻物,你会先靠理解指向厨房,再通过探索找到零食。这显示理解与探索相互推动、交替进行。

研究难点:表征、训练与数据的三重挑战

实时语义表征:如何构建在线更新的3D语义地图,融合空间与语义信息,并处理RGB-D流?探索-理解协同训练:如何统一优化探索策略与语义理解,打破模块化割裂?高效数据采集:如何结合虚拟与真实环境,低成本构建自动化导航数据?

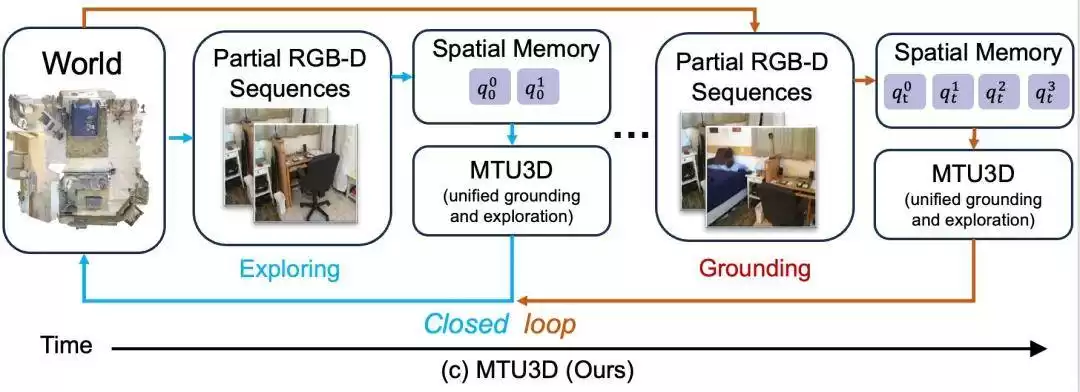

核心思路:探索与理解协同的闭环系统

该研究将具身导航建模为探索与视觉落地协同的闭环过程。智能体通过RGB-D感知积累空间记忆,主动寻找目标;当记忆足够时,则根据指令匹配语义位置导航。这统一了强化学习的探索能力与3D视觉语言模型的理解能力,形成端到端协同。

探索推动理解,理解引导探索,实现高效任务执行。

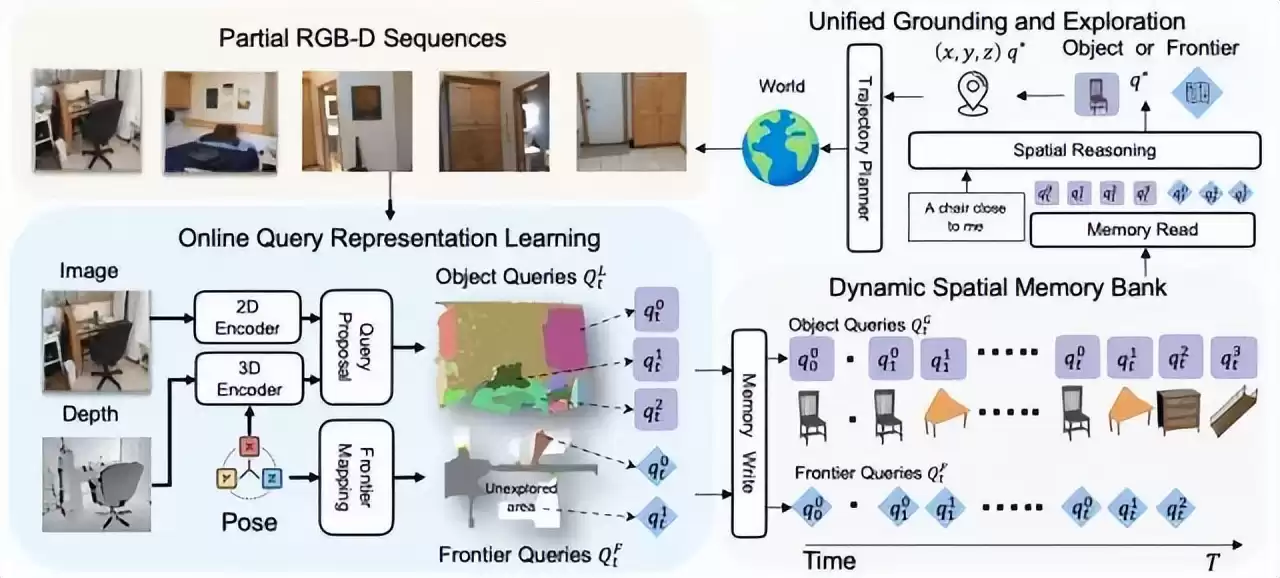

模型设计:双模块协同与数据融合

模型包括在线空间记忆构建与空间推理决策模块,在统一框架下协同优化。

在线空间记忆构建

每帧接收RGB-D序列,输入2D Encoder和3D Encoder提取多模态特征。通过Query Decoder转化为物体表示,涵盖位置、大小、语义和置信度。同时,用Frontier-based Exploration识别未探索边界,生成坐标点。所有信息写入动态空间记忆库,支持后续推理。

空间推理与决策

从记忆库读取物体与边界信息,与任务指令交叉注意力融合,识别目标区域。响应机制灵活:若目标已匹配,直接导航;若未观测,则选择最优边界探索,以获取语义信息。

数据收集:虚实结合策略

融合ScanNet的真实轨迹与HM3D的虚拟仿真数据,提升视觉理解与探索能力。真实数据增强语义对齐,模拟数据覆盖丰富探索。最终数据集含超90万条轨迹、上千万指令,涵盖视觉指引、探索行为、目标定位等任务。

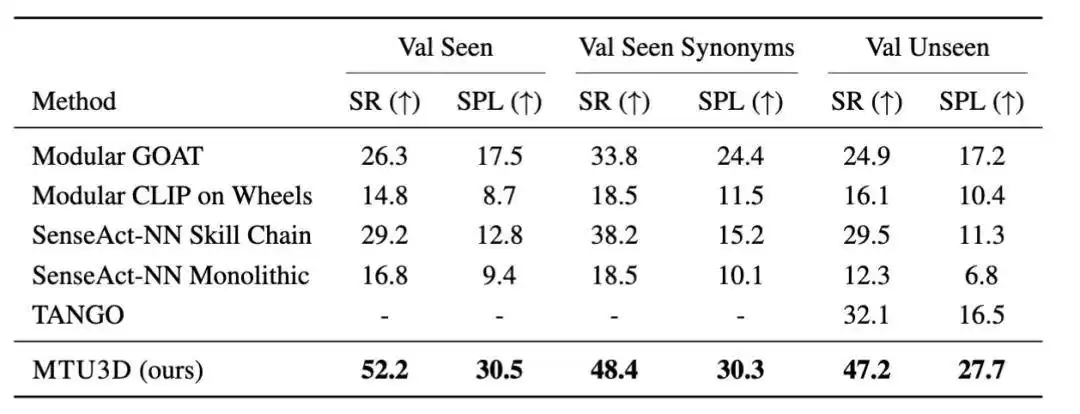

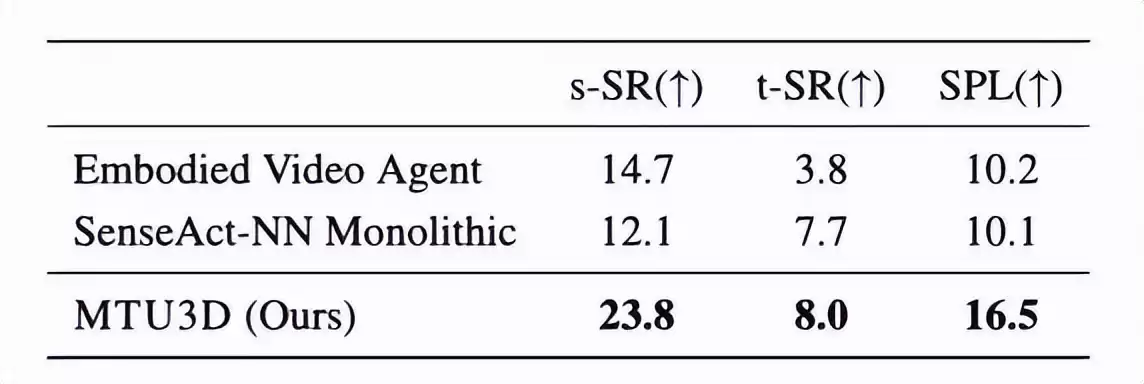

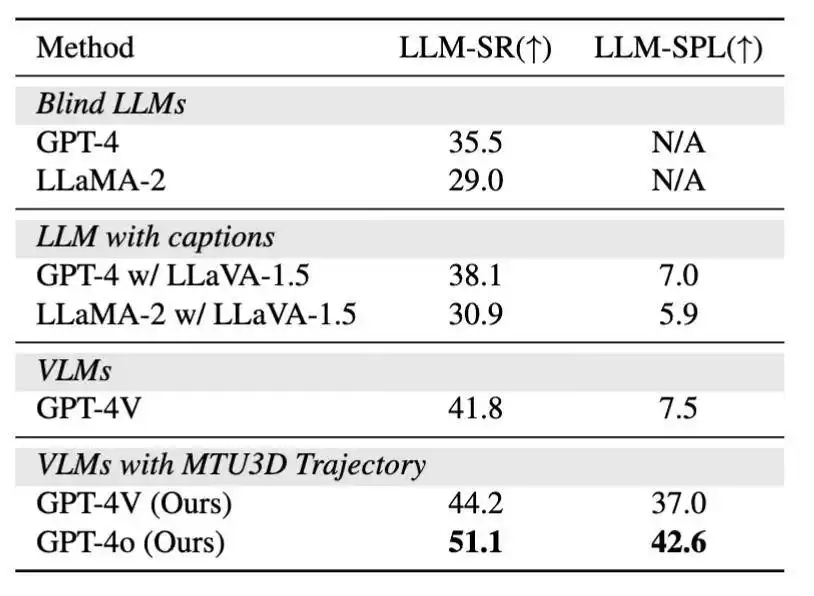

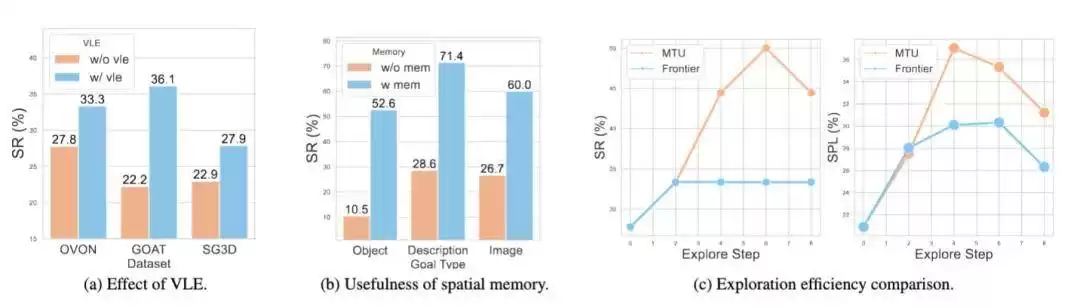

实验结果:多任务性能领先

在HM3D-OVON、GOAT-Bench、SG3D-Nav和A-EQA任务上评估,MTU3D展现强大适应力。GOAT-Bench中,成功率最高提升20%,在多模态理解与长期规划中泛化出色。SG3D-Nav时序任务上,指标全面领先强化学习与模块化方法。A-EQA任务中,探索轨迹提升GPT-4V问答成功率。消融实验显示协同训练策略VLE带来显著提升。

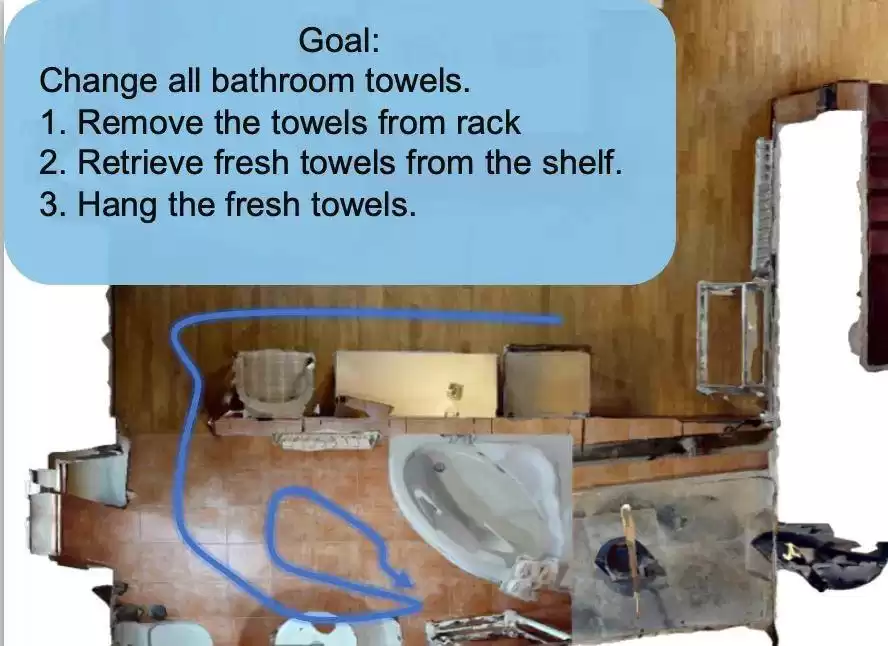

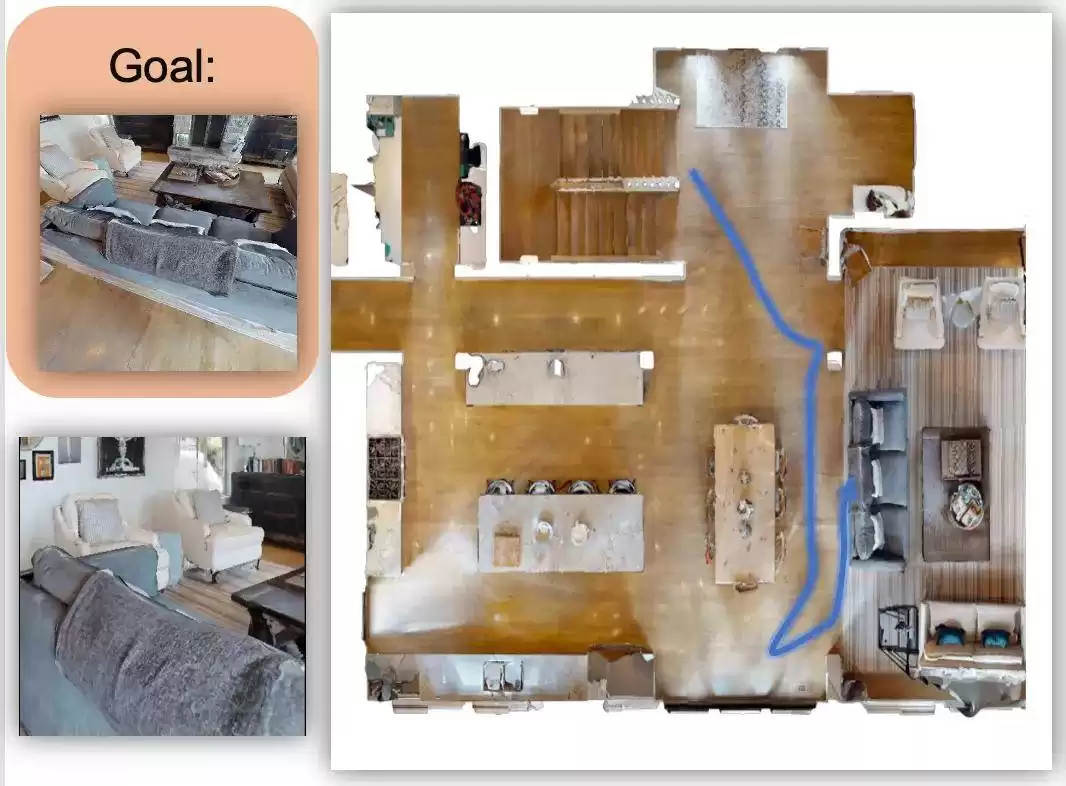

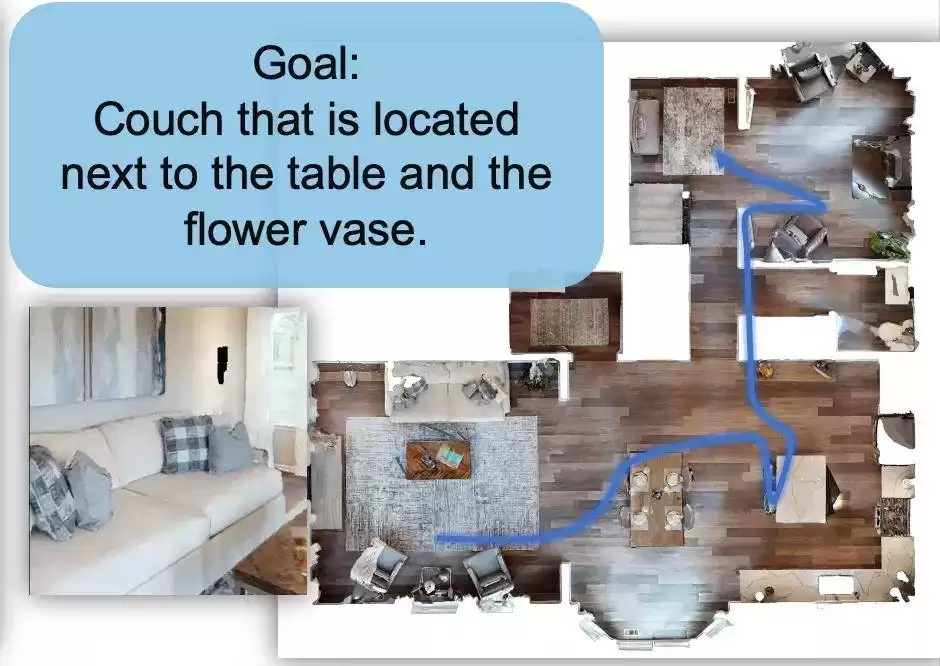

模拟器演示显示,模型能准确完成图像导航、语言定位和多步操作。真机实验视频进一步验证其实用性。

真机实验视频展示模型在真实世界的强大能力。

视频加载中...

视频加载中...

视频加载中...

总结与展望

AI正从“屏幕世界”走向“物理世界”,MTU3D将理解与探索融合,让智能体像人一样边探索边认知。通过虚实数据训练,它在模拟与真机中表现卓越,为具身导航开辟新路径。立即访问项目主页与代码库,亲身体验这一突破,共同探索智能未来!

参考文献:

[1] Liu, Y., et al. "Aligning cyber space with physical world: A comprehensive survey on embodied ai. arXiv 2024." arXiv preprint arXiv:2407.06886.

[2] Zhu, Ziyu, et al. "3d-vista: Pre-trained transformer for 3d vision and text alignment." Proceedings of the IEEE/CVF International Conference on Computer Vision. 2023.

[3] Khanna, Mukul, et al. "Goat-bench: A benchmark for multi-modal lifelong navigation." Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. 2024.

[4] Caron, Mathilde, et al. "Emerging properties in self-supervised vision transformers." Proceedings of the IEEE/CVF international conference on computer vision. 2021.

[5] Liu, Baoyuan, et al. "Sparse convolutional neural networks." Proceedings of the IEEE conference on computer vision and pattern recognition. 2015.

[6] Zhang, Chaoning, et al. "Faster segment anything: Towards lightweight sam for mobile applications." arXiv preprint arXiv:2306.14289 (2023).

[7] Zhu, Ziyu, et al. "Unifying 3d vision-language understanding via promptable queries." European Conference on Computer Vision. Cham: Springer Nature Switzerland, 2024.

[8] Xu, Xiuwei, et al. "Embodiedsam: Online segment any 3d thing in real time." arXiv preprint arXiv:2408.11811 (2024).

[9] Yamauchi, Brian. "Frontier-based exploration using multiple robots." Proceedings of the second international conference on Autonomous agents. 1998.

[10] Dai, Angela, et al. "Scannet: Richly-annotated 3d reconstructions of indoor scenes." Proceedings of the IEEE conference on computer vision and pattern recognition. 2017.

[11] Ramakrishnan, Santhosh K., et al. "Habitat-matterport 3d dataset (hm3d): 1000 large-scale 3d environments for embodied ai." arXiv preprint arXiv:2109.08238 (2021).

[12] Yokoyama, Naoki, et al. "HM3D-OVON: A dataset and benchmark for open-vocabulary object goal navigation." 2024 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS). IEEE, 2024.

[13] Zhang, Zhuofan, et al. "Task-oriented sequential grounding in 3d scenes." arXiv preprint arXiv:2408.04034 (2024).

[14] Majumdar, Arjun, et al. "Openeqa: Embodied question answering in the era of foundation models." Proceedings of the IEEE/CVF conference on computer vision and pattern recognition. 2024.

相关问答

求有关物联网的论文。2000字以上-ZOL问答

求有关物联网的论文。2000字以上手机小米小米6X讨论回答(5)630327311摘...UID技术体系架构由泛在识别码(uCode)、泛在通信器、信息系统服务器、和ucode.....